Table of Contents

확률과 통계과목은 주제만 들어보면 익숙하지만, 막상 내용을 떠올리려 하면 기억이 흐릿해지는 경우가 많다. 오늘 다룰 T-Test 역시 그러한 주제 중 하나다. 그래서 나처럼 배경지식이 많지 않은 사람도 쉽게 이해할 수 있도록 이 글을 작성해 보았다.

Introduction

예를 들어, 두 지역 고등학생들의 수학 성적 수준을 비교하고 싶다고 하자. A지역 고등학교 학생 100명의 평균 수학 점수와 B지역 고등학교 학생 200명의 평균 수학 점수를 비교했을 때, A지역 학생들의 평균 점수가 1.7점 높았다면, 과연 이 차이가 단순한 우연일까, 아니면 실제로 A지역 학생들이 더 뛰어나기 때문일까?

이 질문에 답하기 위해 T-Test가 등장했다. 모든 학생들의 점수를 조사하면 정확한 결론을 내릴 수 있겠지만, “임의로” 선택된 표본은 지역 전체를 완전히 대표하지 못할 가능성이 있다. 예를 들어, 성적이 높은 학생들만 우연히 포함될 수도 있다. 따라서 표본 평균의 차이가 단순한 우연인지, 아니면 유의미한 차이인지를 검증해야 한다.

“T-Test는 두 표본 집단의 평균 차이가 우연에 의해 발생한 것인지, 아니면 실제로 유의미한 차이가 있는지를 확인하는 통계적 검정 방법이다.”

Hypothesis

통계적으로 차이가 유의미한지 판단하기 위해서는 먼저 가설을 설정해야 한다. T-Test에서는 다음 두 가지 가설을 사용한다:

- 귀무가설 (Null Hypothesis, $H_0$): 두 집단의 차이가 우연에 의한 것이며 유의미한 차이가 없다고 가정한다.

- 대립가설 (Alternative Hypothesis, $H_1$): 두 집단 간의 차이가 우연이 아닌 실제 차이로 인해 발생했다고 가정한다.

Standard error

T-Test를 이해하기 위해 먼저 표준 오차를 알아보자. 표준 오차는 “표본 평균이 가질 수 있는 변동성”을 의미한다. 예를 들어, A지역 모든 학생의 수학 점수가 90점이라면, 표본 평균은 언제나 90이므로 변동성이 없다. 하지만 대부분의 경우 표본에는 변동성이 존재한다.

표준 오차를 계산하려면 데이터의 흩어진 정도를 나타내는 분산(Variance)을 사용한다. 모집단의 분산은 다음과 같이 계산된다:

\[Var[X] = \frac{1}{N}\sum_{i=1}^{N}(X_i - \mu)^2\]여기서 $\mu$는 모집단 평균, $\sigma^2$는 모집단 분산을 나타낸다. 반면, 표본 평균과 분산은 $\bar{X}$와 $s^2$로 표시된다.

우리가 계산하고 싶은 것은 각 표본집단의 평균이 갖는 차이에 대한 변동성이다. 말이 어려우나 하나씩 해석해보면 된다. 각 지역의 학생들을 임의로 뽑는 것에는 변동이 있기에 그런 차이들을 계산하고 싶다는 것이다. 수식으로는 $Var(\bar{X}_1 - \bar{X}_2)$ 로 작성한다. 그리고 이것은 분산의 성질에 의해 아래와 같이 전개된다.

\[Var(\bar{X}_1 \pm \bar{X}_2) = Var(\bar{X}_1) + Var(\bar{X}_2)\] \[\begin{aligned} Var(\bar{X}) &= Var\left(\frac{1}{n}\sum_{i=1}^{n}X_i\right) \\ &= \frac{1}{n^2}Var\left(\sum_{i=1}^{n}X_i\right) \\ &= \frac{1}{n^2}\sum_{i=1}^{n}Var(X_i) \\ &= \frac{\sigma^2}{n} \end{aligned}\] \[\therefore Var(\bar{X}_1 \pm \bar{X}_2) = \frac{\sigma_1^2}{n_1} + \frac{\sigma_2^2}{n_2}\]놀랍게도 우리는 표준 오차를 거의 다 계산했다. 모집단 자체의 데이터를 얻기가 매우 어려운 경우가 많아 보통 이를 표본의 데이터로 대체하여 사용하곤 한다. 물론 모집단의 통계량(평균, 분산 등)과 표본집단의 통계량은 엄밀히 말하면 다르다. 그래서 아래에서는 근사(approximation) 기호로 작성했다.

\[Var(\bar{X}_1 - \bar{X}_2) = \frac{\sigma_1^2}{n_1} + \frac{\sigma_2^2}{n_2} \approx \frac{s_1^2}{n_1} + \frac{s_2^2}{n_2}\]분산 값은 평균과 데이터 사이의 차이에 대한 제곱합으로 구성되므로, 제곱 값이 아닌 원래 scale로 되돌리기 위해 제곱근을 취한다. 그리고 지금까지 계산한 값을 두집단의 표본 평균의 차이가 갖는 표준 오차(standard error)라고 한다.

\[SE = \sqrt{Var(\bar{X}_1 - \bar{X}_2)} = \sqrt{\frac{s_1^2}{n_1} + \frac{s_2^2}{n_2}}\]T value

T 값은 표본 평균의 차이를 표준 오차로 나눈 값으로, 두 집단 간의 차이가 표준화된 척도로 얼마나 큰지를 나타낸다. 이를 수식으로 표현하면:

\[T\; value = \frac{\bar{X}_1 - \bar{X}_2}{Std(\bar{X}_1 - \bar{X}_2)} = \frac{\bar{X}_1 - \bar{X}_2}{SE}\]이제 T 값을 계산했으니, 이를 기준으로 두 집단 간의 차이가 유의미한지 확인하면 된다. 방법은 간단하다. T 값이 특정 임계값(critical value)을 초과하면, 두 집단 간의 차이가 우연이 아니라고 판단한다. 반대로 T 값이 임계값을 넘지 못하면, 두 집단의 차이는 우연에 의한 것으로 본다. 이렇게 T-Test는 매우 간결한 과정으로 이루어진다.

Critical value

임계값은 T-Test에서 차이가 유의미하다고 판단할 기준이 되는 값이다. 일반적으로 유의 수준(significance level)을 5%로 설정하며, 이는 귀무가설을 기각할 확률을 의미한다. 임계값은 T 분포를 사용하여 결정된다.

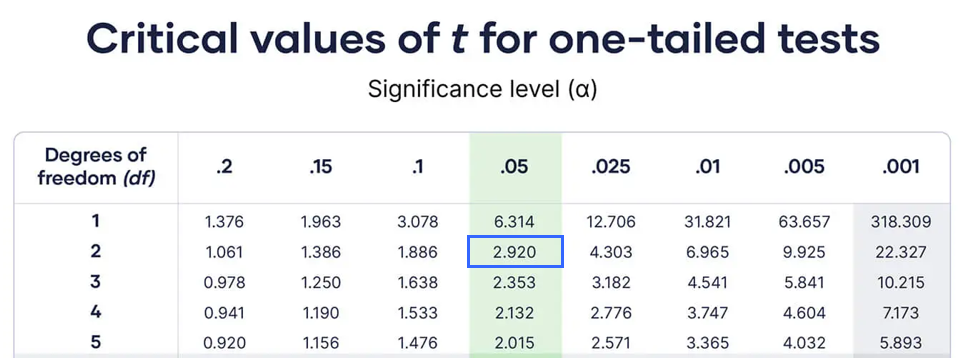

임계값을 확인하는 과정은 다음과 같다:

- 유의 수준(significance level)과 자유도(degree of freedom)를 선택한다.

- 선택한 값을 기반으로 T 테이블에서 임계값을 찾는다.

예를 들어, 자유도가 2이고 유의 수준이 5%일 때, 단측 검정을 수행한다면, T 테이블에서 해당 값을 확인할 수 있다. 아래는 T 분포에서 임계값이 어떻게 설정되는지 보여주는 예시 그림이다.

출처: https://www.scribbr.com/statistics/students-t-table/

출처: https://www.scribbr.com/statistics/students-t-table/

이와 같이 임계값은 T 분포와 유의 수준에 따라 미리 계산된 값을 참조하여 결정된다. 이 과정을 통해 우리가 계산한 T 값과 비교하여 결과를 도출할 수 있다.

Degree of freedom

임계값을 알기위해 유의수준 뿐만 아니라 자유도 값도 필요로 한다. 자유도라는 것은 개인적으로 통계학에서 가장 이해하기 어려운 개념이라고 생각이든다. 보통 자유도는 “표본집단에서 독립적으로 값을 할당할 수 있는 변수의 개수”로 표현한다.

모집단에서 크기 $n$ 의 표본을 선택하고 싶다고 한다면, 실제로 선택하기 전까지 각 표본 값들은 언제든 값이 변화되는 상태를 갖는다. 즉 내가 꺼내보지 않을 때 까지는 어떤 값이든 될 수 있는것이며 이는 값에 ‘자유’가 있는 것이다. 따라서 이 경우 크기 $n$ 의 표본 집단에 대한 자유도는 $n$ 이다.

그러나 평균이 10이 되도록 하는 표본집단을 구성해라 라고 해보자. 평균이라는 ‘제약 조건’이 걸린 순간 더 이상 모든 표본 값에는 자유가 존재하지는 않게 된다. $n - 1$ 개의 값에는 자유가 여전히 있지만 마지막 1개만 남는 순간 어떻게든 평균을 맞추기 위해 특정 값을 선택할 수 밖에 없다. 이때의 자유도는 $n-1$ 이다.

\[s^2 = \frac{1}{n-1}\sum_{i=1}^n (x_i - \bar{x})\]표본 분산의 식을 보면 더 잘 알게된다. 각각의 변수에는 자유가 있지만, 평균값이 수식에 이미 정의되어 있기에 자유를 1개 잃게 되는 것이다. 이처럼 표본 분산은 자유도를 고려한 통계량이다.

여기서 기억하는가? 위에서 우리는 모분산을 정확하게 알지 못하기 때문에 표본 분산을 사용하기로 했고, 이는 T value를 구하는 과정속에 여전히 남아있다. 따라서 자유도를 고려해야하는 것이다.

T distribution

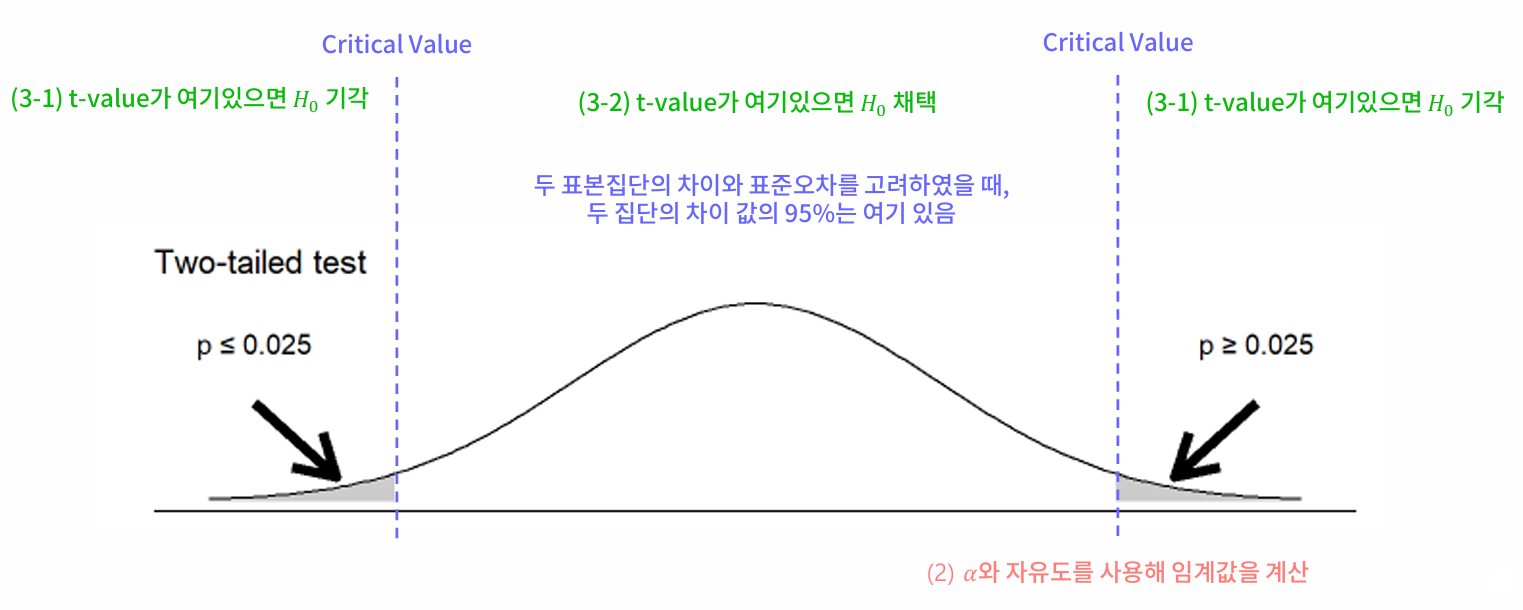

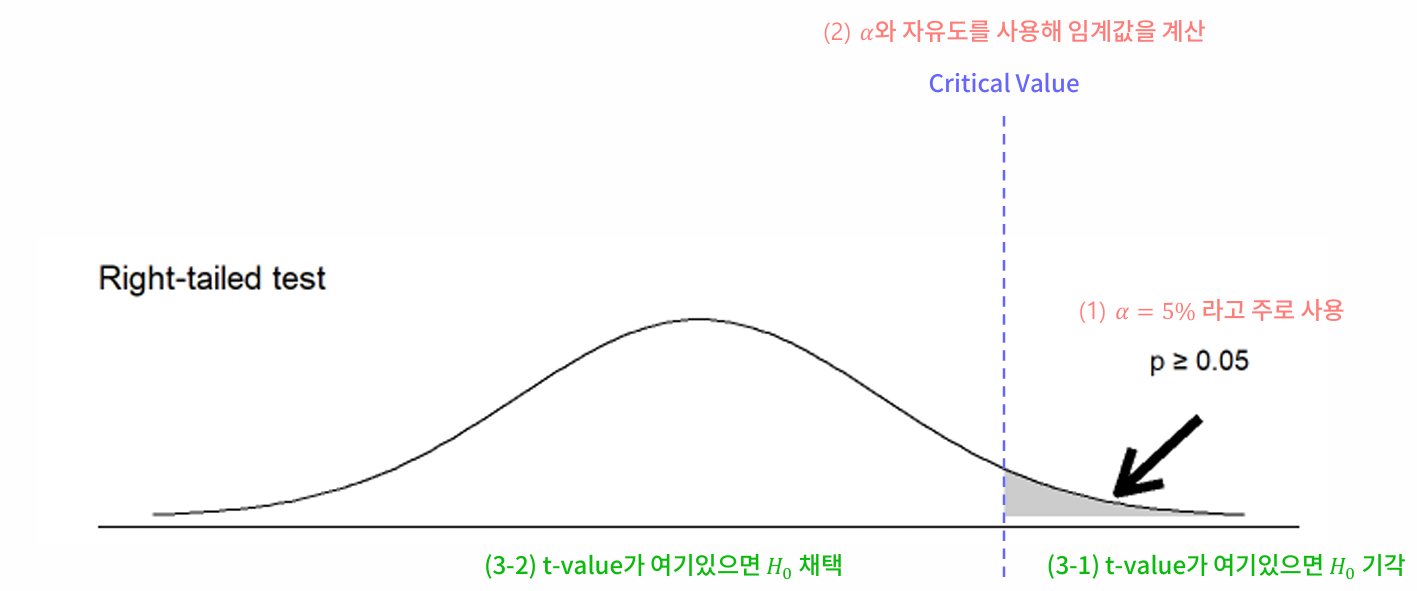

Critical value는 T value가 존재하는 T 분포에서 유의수준과 자유도를 고려했을 때의 임계값이다. 그림으로 보면 다음과 같다.

중앙에서 멀리 떨어질 수록 해당 t value 값이 등장하기 힘들다는 것이고, 그런 경유의 t value가 되기 위해서는 두 표본 평균의 차이가 커야 한다. 차이는 집단에 따라 음수가 될 수 있고 양수가 될 수 있기에 양측에 2.5% 씩 귀무 가설을 기각할 비율을 배분한다.

이렇게 음수 또는 양수가 되는 모든 경우를 고려할 때를 양측 검정 (two-tailed T test)이라 한다. 만약 두 집단의 차이가 반드시 음수이거나 반드시 양수인 경우를 가정하고 있다면 단측 검정 (one-tailed T test)을 사용한다.

Various types of T Test

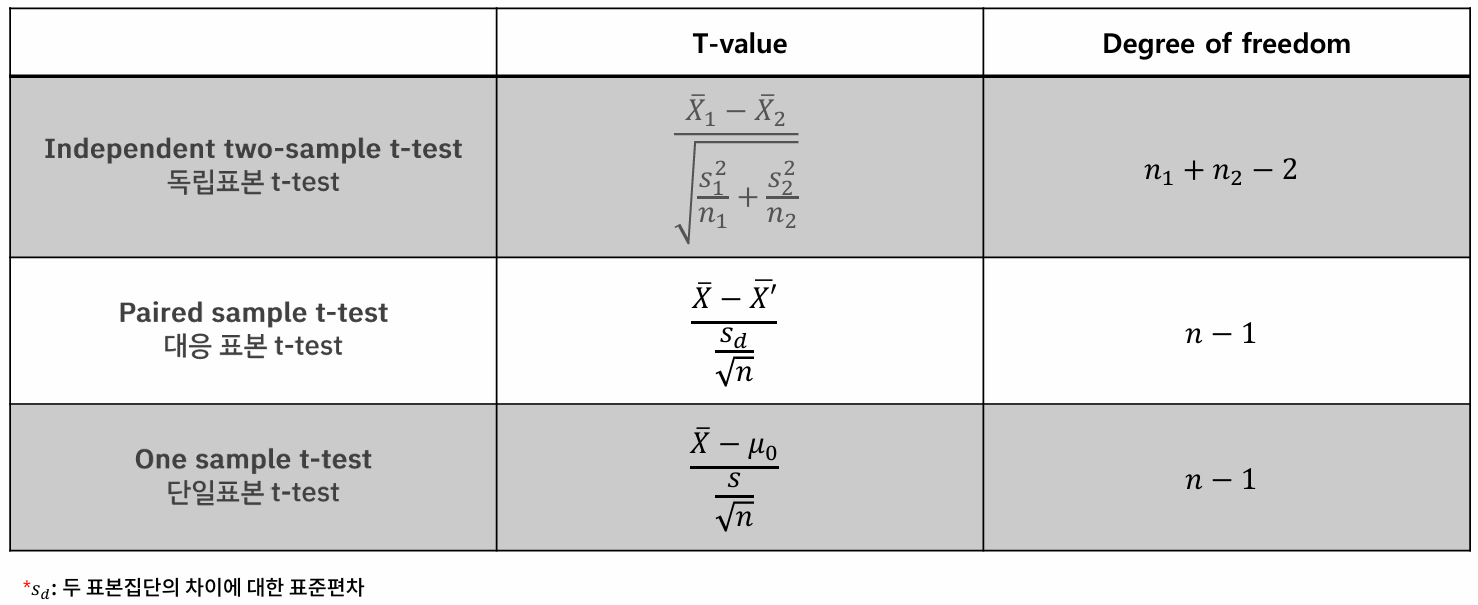

T-Test는 표본 집단의 성격에 따라 다음과 같이 나뉜다:

-

독립 표본 T-Test (Independent Sample T-Test): 서로 독립적인 두 집단 간의 차이를 비교. 예를 들어, A지역 학생들과 B지역 학생들의 수학 점수를 비교.

-

쌍체 표본 T-Test (Paired Sample T-Test): 동일한 집단의 두 시점 또는 조건을 비교. 예를 들어, A반 학생이 학원에 다니기 전과 후의 시험 점수를 비교.

-

단일 표본 T-Test (One Sample T-Test): 표본 평균과 정해진 기준값을 비교. 예를 들어, 특정 시험의 평균 점수가 75점인 상황에서, 새로운 학생 집단의 점수가 이와 유의미하게 다른지 검증.

Summary

T test는 통계적 검정기법 중 하나로 두 표본 집단이 갖는 차이가 우연에 의해 발생한 것인지 알아보는 검정 방법이다. 세부적으로는 표본 집단의 성격에 따라 독립 표본 검정, 쌍체 검정, 단일 검정으로 나뉠 수 있고, 가설의 종류에 따라 양측 검정 그리고 단측 검정으로 분류될 수 있다.

Start the conversation